Социалните медии се превръщат все по-бързо в средство за манипулация и разпространение на фалшива информация. Основен инструмент за това са ботовете – хора или машини, маскирани като потребители на Facebook, Twitter, Reddit и т.н. Борбата на платформите и фирмите за киберсигурност е да ограничат влиянието на фалшивите профили, като създадат ефективни алгоритми за разпознаването им.

Тенденцията на разпространение се увеличава с размах

Застрашителният мащаб на разпространение на фалшива информация в социалните медии принуждава вземането на радикални мерки. Сред тях са минимизиране на бот-трафика и ограничаване на подвеждащата информация.

През 2019 г. Facebook е закрила над 5 млрд. фалшиви акаунта. През април 2020 г. на YouTube се наложи да премахне от платформата си конспиративни видеа, които твърдят, че така актуалният коронавирус може да се разпространява чрез новата 5G мрежа.

Технологията еволюира

Развитието на изкуствения интелект подпомогна, очаквано, и еволюцията на разпространение на фалшива информация. Сигурно сте чували за deepfake? Накратко, това е манипулирана чрез machine learning форма на медия – видео, аудио или дори само снимка (терминът всъщност идва от „deep learning“ – методът на машинно самообучение на изкуствен интелект с помощта на изкуствени невронни мрежи).

Манипулациите варират от фабрикувани изказвания до участие на известни личности във филми за възрастни. Последната новост при deepfake манипулацията може дори да бъде направена на живо – например това видео, в което копие на Марк Цукърбърг твърди, че Facebook има контрол над откраднатите лични данни на милиарди хора.

Обезпокояващото е, че технологията напредва, става все по-достъпна, а качеството на deepfake съдържанието – все по-добро и трудно различимо от автентичното. Повече информация за deepfake може да прочетете в този пост The Guardian.

Как да разпознаем дезинформацията?

Обикновено, фалшивите новини са добре прикрити. Най-често, те се публикуват от профили в социални мрежи, максимално близки до такива на реални хора. Ние ги наричаме ботове. Най-лесният начин да разпознаете фалшива информация е, като хванете първоизточника ѝ – бота.

Има множество признаци, по които да разберем дали един профил е създаден с цел манипулация. Ето кои са те:

- Профилната снимка липсва или пък е съмнително „лъскава“ (често хората зад ботовете използват снимки на реално съществуващи и привлекателни личности, качили своите снимки онлайн).

- Споделената лична информация обикновено е противоречива

- Честотата, с която се споделя и публикува информация е твърде голяма – замислете се, колко хора имат свободно време да пускат 50-60 поста на ден. Въпреки че всеки от нас има поне един такъв реален приятел, вероятността при подобен обем да не става дума за истински човек е голяма.

- В историята на профила се виждат постове на различни езици.

- Профилът съществува отскоро – едва ли ще срещнете бот, просъществувал повече от няколко месеца. Причината: обикновено профилът бива разкрит и трябва да бъде сменен.

- Граматиката и структурата на езика е объркана и личи използването на автоматичен преводач.

- Броят и видът на контактите също може да бъде показателен за това дали даден профил е истински или не.

За компаниите, обявили война на подобни „вредители“ и фалшивите новини и съдържание, които те разпространяват, има не един и два инструмента за разпознаване на фалшиви профили. Тук ще споделим малко повече за BotSight на NortonLifeLock Research Group.

Как изкуственият интелект засича ботове?

BotSight използва в своята бета-версия вече тестваният Machine Learning модел, който може да засича ботове в Twitter с точност между 96.7% и 100%.

Прави се преглед на над 10 различни фактора при всеки акаунт, като например дали е верифициран, скорост на събиране на последователи, описание на акаунта и т.н.

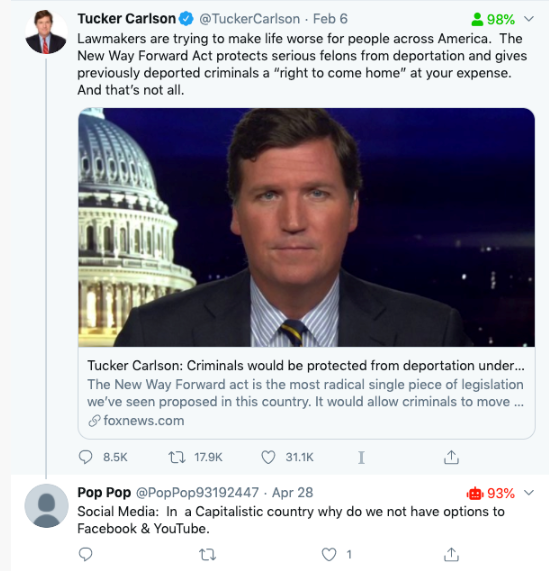

Инструментът на Norton показва малка икона с процент, указващ дали акаунтът е бот или човек. Софтуерът все още е прототип и е възможно някои акаунти да бъдат маркирани неправилно. Ето как изглежда изчислението за Тwitter:

Над 20% фалшиви постове

Досега потребителите на BotSight са анализирали успешно над 100 хил. Twitter акаунта, като отчетеният резултат има възможност да се визуализира директно на екрана. Установено е, че около 5% от всички туитове принадлежат на ботове.

Въпреки че този процент намалява с времето, той зависи и от езика, от темата и от моментът, в което тя се обсъжда и може да достигне 20% при известни теми и хаштагове, като например #COVID19.

Съществуват и други онлайн инструменти, които може да бъдат използвани за засичане на ботове:

- Botometer – създаден от университета в Индиана, САЩ, който измерва вероятността един Twitter акаунт дали е бот или не.

- Bot Manager, платено приложение, което прилага Intent-Based Deep Behavior Analysis (IDBA), за да различава отделните потребителски профили в социалните медии. Това е бизнес решение, което помага за засичането и идентифицирането на големи групи от социални бот-мрежи, които разпространяват дезинформация.

Употреба с положителни цели

Ботовете могат да се използват и с добро. Платформата Reddit се възползва от съвременните технологии, за да направи автоматизирани инструменти като “Remind Me”. Това е бот, който има потребителски акаунт и всеки в социалната мрежа може да го използва.

При зададени конкретни команди той може да напомня за определени постове след конкретно зададено време. Потребителите дори са направили собствен subreddit, в който е позволено само ботове да качват нови постове. Може да го откриете на r/SubredditSimulator. Отличителното при този subreddit е, че наблюдава поведението на други ботове без да разпространява дезинформация.

Във връзка с многобройните фалшиви и подвеждащи новини, свързани с COVID-19, създателите на платеното приложение Newsguard обявиха, че до 1 юли 2020 г. тяхната услуга ще стане безплатна за всички потребители на новия Microsoft Edge.

В заключение можем да обобщим, че доста хора се доверяват на информацията в социалните мрежи и рядко правят задълбочена проверка. От друга страна, самите социални мрежи все по-често че възползват или създават сами технологични решения, целящи да ограничат разпространението на фалшиви новини, подвеждаща информация и несъществуващи профили. Реално, здравословна информационна среда може да бъде постигната чрез единни усилия на потребители и платформи, насочени в положителна посока.